- Главная

- Новости

- Telegram

- Viber

- ВКонтакте

- Скопировать ссылку

Когда чат превращается в платформу: все нововведения OpenAI Dev Day 2025

OpenAI провела свое главное событие года — DevDay 2025. И если прошлые презентации компании были шагами, то эта стала прыжком. OpenAI окончательно перестала быть просто создателем моделей вроде GPT или DALL·E. Нет, компания хочет создать полноценную экосистему — с инструментами, инфраструктурой и даже амбициями выйти за пределы экранов. Рассказываем о новых инструментах, которые станут частью ChatGPT и как они изменят наше взаимодействие с ботом.

ChatGPT Apps: программы внутри чат-бота

Главный анонс мероприятия — запуск ChatGPT Apps и SDK для разработчиков. Теперь внутри ChatGPT можно использовать сторонние сервисы вроде Canva, Zillow, Coursera, Booking или Spotify, не выходя из чата. Пользователь пишет “создай афишу концерта” и ChatGPT передаёт запрос Canva. Попросишь “найди жильё у моря” — откроется интерфейс Zillow прямо в окне диалога.

Для разработчиков открывается ранний доступ к SDK, позволяющий интегрировать свои приложения и создавать новые сценарии взаимодействия. Позже появится каталог, где можно будет публиковать собственные решения. Фактически это будущий магазин приложений внутри ChatGPT. Можно смело утверждать, что компания видит свой продукт не просто чат-ботом или виртуальным ассистентом, а полноценной ОС, где все взаимодействие реализовано через простые естественные команды.

AgentKit: новая волна «умных помощников»

Второй громкий анонс — AgentKit, набор инструментов для создания и развёртывания автономных ИИ-агентов. Это больше, чем просто API: теперь можно собрать систему, которая сама анализирует данные, вызывает внешние сервисы, принимает решения и выполняет действия. Агент может стать внутренним сотрудником компании, редактором новостей или логистическим оператором — без участия человека. Разработчикам больше не нужно вручную собирать цепочки действий между моделями и API: всё работает как конструктор.

Sora 2: текст превращается в видео

OpenAI подтвердила выход Sora 2 — обновлённой модели генерации видео. Она будет доступна через API и уже умеет создавать реалистичные сцены по текстовым сценариям. Теперь короткие видеосцены, промо и сториборды теперь можно будет собирать прямо из диалога с ИИ. Новая модель обещает улучшенную синхронизацию звука с видео, поддержку сложных промтов и "богатые звуковые ландшафты и синхронизированные аудиоэффекты".

Codex: ИИ-соавтор программиста доступен всем

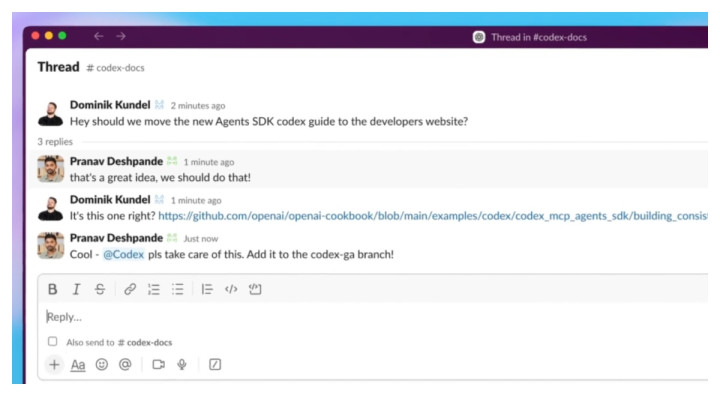

На Dev Day OpenAI официально объявила, что Codex выходит из режима исследования и будет доступна широкой аудитории. Инструмент также получил набор новых опций, среди которых интеграция с Slack: можно упоминать @Codex в канале, давать задачу, и ассистент подхватит контекст переписки, выполнит код или предложит изменения.

Codex SDK позволит встроить агента Codex в ваши собственные инструменты и рабочие процессы.OpenAI говорит, что с момента превью использования Codex выросло более чем в десять раз с начала августа. На сцене Сэм Альтман отметил, что почти весь новый код, который сегодня пишут в OpenAI, генерируется с участием Codex. На данном этапе это не просто подсказчик кода: он действует как агент, который читает ваш репозиторий, запускает тесты, вносит правки, предлагает pull request’ы и может работать в изолированной облачной среде с логами и верификацией.

AMD и Stargate: гонка за мощность

OpenAI объявила о стратегическом партнёрстве с AMD — поставщиком чипов нового поколения Instinct MI450. Соглашение оценивается в миллиарды долларов и предполагает строительство дата-центров суммарной мощностью до 10 ГВт. Это не просто “больше серверов”, это переход к инфраструктуре под кодовым названием Stargate — распределённой сети вычислительных центров, где будут работать будущие поколения GPT и мультимодальных моделей. AMD в ответ получила возможность приобрести до 10% акций OpenAI, что превращает сделку в союз, а не просто контракт на поставку.

Устройства от Джонни Айва: ИИ без экрана

Наконец, нельзя не упомянуть и партнёрство с бывшим дизайнером Apple Джони Айвом. Он работает с OpenAI над новым типом устройств, в которых взаимодействие с ИИ будет происходить не через экран, а через голос, жесты и сенсоры.

Это может быть нечто вроде “умного кулона” или переносного интерфейса, который ощущает настроение человека, его окружение и помогает действовать, не отвлекая взгляд от мира. Проект находится на ранней стадии, но концепция очевидна: OpenAI хочет уйти от “плоского экрана” к “живому окружению” — к ИИ, который чувствует контекст, а не просто обрабатывает команды. Звучит интригующе, однако вызывает и немало скептицизма: это не первая разработка носимого ИИ, однако еще ни одного по-настоящему успешного устройства мы не увидели.

Что в итоге?

Dev Day 2025 зафиксировал стратегический разворот: ChatGPT больше не позиционируется как “умный чат”. Авторы видят его универсальной средой взаимодействия с информацией и сервисами: внутри одного диалога можно будет писать, искать, кодить, бронировать, рисовать и генерировать видео. Что это, если не новый подход ко взаимодействию с носимыми и настольными гаджетами? По данным компании, ChatGPT уже использует 800 миллионов человек в неделю, а API обрабатывает шесть миллиардов токенов в минуту. Цифры огромные, а OpenAI действительно важный игрок в этой категории. Теперь компания хочет конкурировать не с другими чат-ботами, а с браузерами и мобильными платформами.

Как по-вашему, что получится в итоге? Делитесь своими мнениями в комментариях и не забывайте заглядывать в наш Telegram-канал.

Комментарии

Чтобы оставлять комментарии,

пожалуйста авторизуйтесь.

Скоро чат будет общаться сам с собой. А кто то будет кричать. Во глянь сколько народу тут сидит😉

Да всем наплевать мне кажется на все эти чаты хераты никому не нужные напридумывали всякого рода

в массах им пользуются разве что для тупых вопросов, ну и домашку делают. И то справляется он с этим как долб0дятел, впечатление что он с годами не поумнел а отупел и еще больше отолерастел